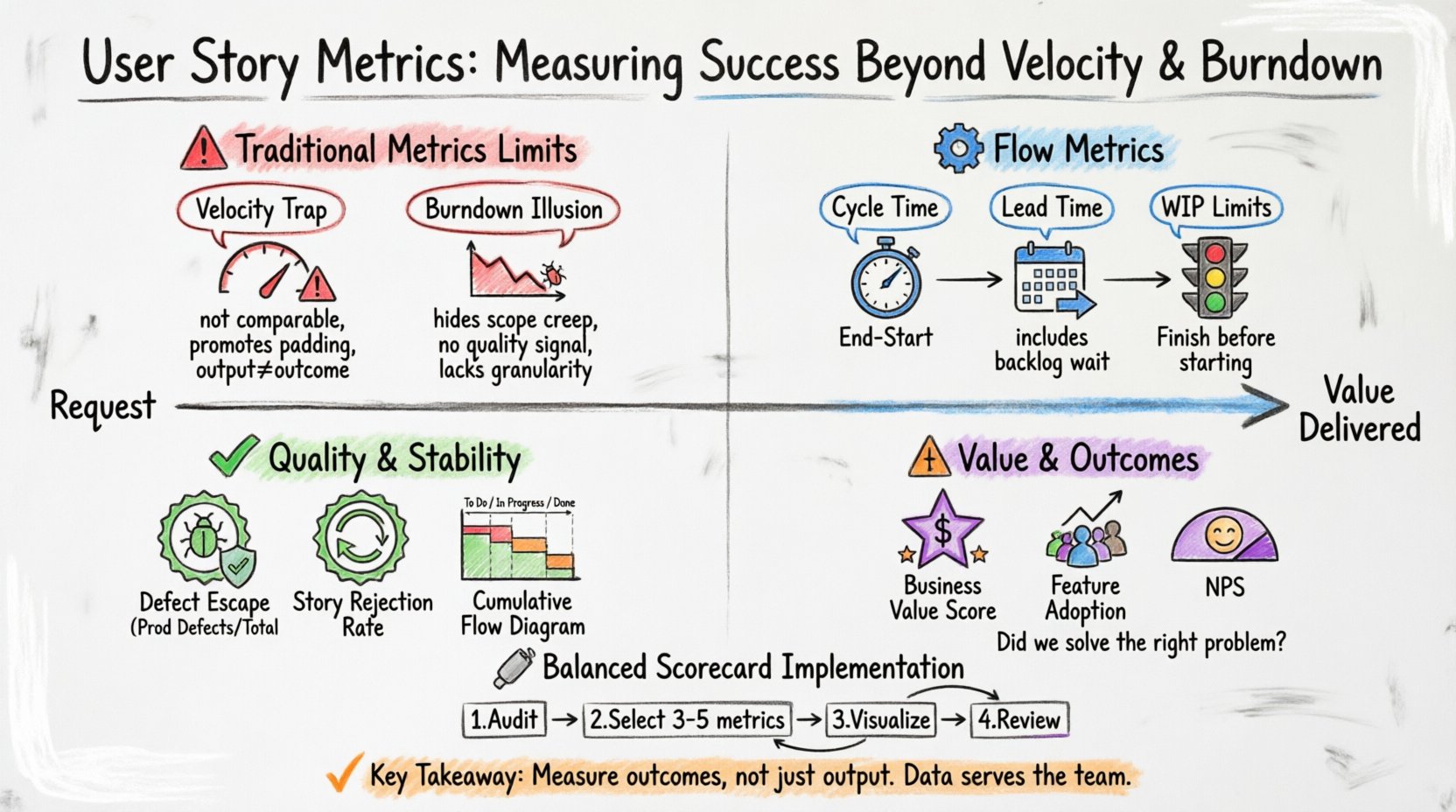

Dans le monde du développement logiciel, les données pilotent la prise de décision. Pendant des années, les équipes se sont appuyées sur quelques chiffres familiers pour évaluer leurs progrès. La vitesse et les graphiques d’épuisement sont les incontournables de l’outil agile. Ils vous indiquent combien de travail est accompli et si vous êtes sur la bonne voie pour terminer une itération. Toutefois, se fier uniquement à ces indicateurs crée un point aveugle. Ils mesurent l’activité, pas la valeur. Ils mesurent le rendement, pas l’issue.

Pour vraiment comprendre l’état de santé de l’équipe et le succès du produit, nous devons aller plus loin. Ce guide explore des métriques avancées des histoires d’utilisateur qui offrent une vision plus claire du flux, de la qualité et de la prévisibilité. Nous dépasserons le simple comptage et commencerons à mesurer ce qui compte vraiment pour une livraison durable.

🚫 Les limites des métriques traditionnelles

La vitesse est définie comme la quantité de travail qu’une équipe termine au cours d’une seule itération. Les graphiques d’épuisement montrent le travail restant au fil du temps. Bien qu’utilisés pour la planification à court terme, ils présentent des inconvénients majeurs lorsqu’ils sont utilisés comme mesure principale du succès.

1. Le piège de la vitesse

- Pas comparables entre les équipes :L’équipe A pourrait estimer une histoire à 5 points, tandis que l’équipe B estime la même histoire à 3 points. Comparer leurs vitesses est sans sens.

- Encourage le remplissage :Si la vitesse est l’objectif, les équipes peuvent surévaluer les points d’histoire pour créer une marge de sécurité. Cela gonfle la métrique sans ajouter de véritable valeur.

- Se concentre sur le rendement, pas sur l’issue :Une équipe peut avoir une haute vitesse en terminant de nombreuses petites tâches à faible valeur. Elle pourrait livrer du code que les utilisateurs n’ont pas besoin ou qui introduit une dette technique.

- Encourage le jeu du système :Les équipes pourraient scinder artificiellement des histoires simplement pour augmenter le nombre d’éléments terminés, plutôt que de se concentrer sur la livraison d’une fonctionnalité cohérente.

2. L’illusion du graphique d’épuisement

- Cache l’expansion du périmètre :Une ligne plate sur le graphique d’épuisement peut sembler un problème, mais cela pourrait signifier que du nouveau travail a été ajouté pour compenser le travail retiré. Le graphique ne montre pas toujours le contexte expliquant pourquoi la ligne est restée plate.

- Ne mesure pas la qualité :Un graphique d’épuisement atteint zéro même si le travail contient des bogues. La ligne ne suit pas le nombre de fois où le travail a été rejeté en raison de problèmes de qualité.

- Manque de granularité :Il regroupe tout le travail en un seul chiffre. Il ne peut pas distinguer entre une correction critique de bogue et un petit ajustement d’interface utilisateur.

Quand vous vous fiez uniquement à ces métriques, vous risquez d’optimiser pour le graphique plutôt que pour le produit. Vous avez besoin de métriques qui révèlent l’état de santé du processus lui-même.

⚙️ Métriques de flux : comprendre le parcours

Les métriques de flux se concentrent sur le déplacement du travail à travers le système. Elles aident à identifier les goulets d’étranglement et à mesurer l’efficacité. Ces métriques sont essentielles pour comprendre à quelle vitesse la valeur atteint l’utilisateur.

1. Temps de cycle

Le temps de cycle mesure le temps écoulé depuis le début réel du travail sur une histoire d’utilisateur jusqu’à ce qu’elle soit prête à être livrée. Contrairement à la vitesse, qui se concentre sur le volume de rendement, le temps de cycle se concentre sur la vitesse.

- Pourquoi cela importe :Des temps de cycle plus courts entraînent généralement des boucles de retour plus rapides. Si une équipe peut passer rapidement d’une histoire « En cours » à « Terminée », elle peut valider ses hypothèses plus tôt.

- Comment le calculer :Soustrayez la date de début de la date de fin.

- Cible : Recherchez les tendances. Un temps de cycle décroissant indique une amélioration de l’efficacité. Un temps de cycle croissant signale un goulot d’étranglement.

2. Délai de livraison

Le délai de livraison est le temps total écoulé depuis la demande (ou la création d’une histoire) jusqu’à la livraison. Il inclut le temps d’attente avant même que le travail ne commence.

- Pourquoi cela importe : C’est la métrique que les clients vivent réellement. Elle mesure la réactivité globale de l’organisation.

- Différence : Le délai de livraison inclut le temps d’attente dans le backlog. Le temps de cycle ne l’inclut pas.

- Impact : Réduire le délai de livraison améliore la satisfaction client et permet une adaptation plus rapide au marché.

3. Travail en cours (WIP)

Le WIP limite le nombre d’histoires traitées simultanément. Limiter le WIP impose une concentration et une finalisation.

- Changement de contexte : Un WIP élevé entraîne des changements de contexte, ce qui réduit les performances cognitives.

- Identification des goulets d’étranglement : Si le WIP est élevé mais que la finalisation est faible, le travail est bloqué quelque part dans le pipeline.

- Stratégie : Établir des limites de WIP encourage l’équipe à terminer une histoire avant d’en commencer une autre.

🎯 Métriques de qualité et de stabilité

La vitesse sans qualité est une menace. Les équipes doivent mesurer la stabilité de leur livraison pour s’assurer que la vitesse ne se fait pas au détriment de la santé technique.

1. Taux d’échappement des défauts

Cette métrique suit le nombre de défauts découverts par les utilisateurs ou en production par rapport à ceux trouvés pendant les tests.

- Calcul : (Défauts en production / Défauts totaux trouvés) * 100.

- Objectif : Un pourcentage plus faible indique une meilleure couverture des tests et une détection plus précoce des bogues.

- Risque : Un taux élevé suggère que les barrières de qualité sont contournées ou que les tests sont insuffisants.

2. Taux de rejet des histoires

Avec quelle fréquence une histoire échoue aux critères d’acceptation et est-elle renvoyée au développement ?

- Implication :Un taux élevé de rejet indique une mauvaise communication entre les propriétaires de produit et les développeurs.

- Cause racine : Cela peut également signifier que les critères d’acceptation sont flous ou que la définition de fin est incohérente.

- Avantage : Suivre cela permet d’affiner le processus de révision et de clarifier les exigences avant le début du travail.

3. Diagramme de flux cumulé (CFD)

Une représentation visuelle des états du flux de travail au fil du temps. Il montre le volume de travail à chaque étape (par exemple, À faire, En cours, Terminé).

- Analyse : Si la bande « En cours » s’élargit, le travail s’accumule. Si la bande « Terminé » est étroite, le débit est faible.

- Visibilité : Il offre une vue d’ensemble de la capacité du système et de ses contraintes.

💰 Métriques de valeur et de résultat

En fin de compte, le logiciel existe pour résoudre des problèmes. Les métriques doivent refléter la valeur livrée, et non seulement le code écrit.

1. Valeur métier livrée

Attribuer un score de valeur aux histoires d’utilisateur aide à prioriser le travail qui compte le plus. Cela peut être fait par les parties prenantes à l’aide d’un modèle de notation simple.

- Modèle de notation : Noter les histoires en fonction de leur impact sur les revenus, de la satisfaction des utilisateurs ou de leur alignement stratégique.

- Suivi : Additionner les scores de valeur des histoires terminées par sprint ou par trimestre.

- Changement : Cela déplace la conversation de « Combien de points avons-nous terminés ? » à « Quelle valeur avons-nous générée ? »

2. Taux d’adoption des fonctionnalités

Une fois qu’une histoire est en production, quelqu’un l’utilise-t-il ?

- Mesure : Suivre le nombre d’utilisateurs actifs ou la fréquence d’utilisation de la fonctionnalité spécifique.

- Retour : Un faible taux d’adoption indique qu’une fonctionnalité pourrait ne pas être nécessaire ou être difficile à utiliser.

- Itération : Les données ici permettent de décider si l’on doit investir davantage dans une fonctionnalité ou l’abandonner.

3. Score de recommandation nette (NPS)

Bien que ce ne soit pas une métrique au niveau de l’histoire, le NPS suit l’opinion globale des clients. Il est corrélé à la qualité des histoires livrées.

- Connexion : Si le NPS baisse alors que la vitesse augmente, il y a un problème avec la qualité ou la pertinence du travail accompli.

- Alignement : Il aligne l’équipe de développement sur les objectifs commerciaux concernant la satisfaction client.

📋 Comparaison des métriques clés

Comprendre quand utiliser chaque métrique est crucial. Le tableau ci-dessous résume l’objectif, le calcul et le domaine d’attention de chaque catégorie.

| Métrique | Domaine d’attention | Calcul | Utilisation principale |

|---|---|---|---|

| Vitesse | Planification de la capacité | Somme des points d’histoire accomplis | Prédiction de la capacité du sprint |

| Temps de cycle | Efficacité | Date de fin – Date de début | Identification des goulets d’étranglement |

| Temps de traitement | Réactivité | Date de livraison – Date de demande | Mesure de l’expérience client |

| Taux de fuite de défauts | Qualité | Défauts en production / Défauts totaux | Évaluation de l’efficacité des tests |

| Nombre d’éléments en cours | Concentration | Nombre d’éléments actifs | Gérer le multitâche |

| Note de valeur | Impact | Évaluation des parties prenantes | Prioriser le travail à fort impact |

🛠️ Mise en œuvre d’un tableau de bord équilibré

Adopter ces indicateurs exige un changement de mentalité. Il ne s’agit pas d’ajouter davantage de suivi ; il s’agit de suivre les bonnes choses. Voici une approche étape par étape pour mettre en œuvre une vision équilibrée.

1. Audit des indicateurs actuels

- Examinez les données actuellement rapportées aux dirigeants.

- Identifiez quels indicateurs influencent le comportement.

- Demandez : « Optimisons-nous pour l’indicateur ou pour le résultat ? »

2. Sélectionner un ensemble fondamental

- Ne cherchez pas à mesurer tout d’un coup. Sélectionnez de 3 à 5 indicateurs clés.

- Choisissez-en un dans chaque catégorie : Flux, Qualité et Valeur.

- Assurez-vous que l’équipe est d’accord sur les définitions et les méthodes de calcul.

3. Visualiser la transparence

- Affichez les indicateurs là où l’équipe peut les voir quotidiennement.

- Utilisez des tableaux de bord qui se mettent à jour automatiquement.

- Évitez d’utiliser les indicateurs pour les évaluations individuelles. Concentrez-vous sur les performances de l’équipe.

4. Réviser régulièrement

- Discutez des indicateurs lors des réunions de rétrospective.

- Demandez : « Que nous apprendent ces données sur notre processus ? »

- Adaptez le processus en fonction des insights, et non seulement des chiffres.

⚠️ Pièges courants à éviter

Même avec de bonnes intentions, la mise en œuvre des indicateurs peut mal tourner. Faites attention à ces pièges courants.

- Loi de Goodhart :Quand une mesure devient une cible, elle cesse d’être une bonne mesure. Si vous liez les primes à la vitesse, vous manipulerez la vitesse.

- Surcharge de données :Recueillir trop de données crée du bruit. Concentrez-vous sur des informations exploitables.

- Ignorer le contexte : Une augmentation du temps de cycle pourrait être due à un projet complexe, et non à une inefficacité de l’équipe. Examinez toujours le « pourquoi » derrière les chiffres.

- Dépendance à l’outil : Ne laissez pas les limites de votre système de suivi déterminer ce que vous mesurez. Si vous ne pouvez pas mesurer la valeur parce que l’outil ne le supporte pas, trouvez une méthode manuelle pour le faire.

🧠 Santé de l’équipe et prévisibilité

Au-delà des indicateurs techniques, l’élément humain de l’équipe détermine le succès à long terme. Les indicateurs reflétant la stabilité de l’équipe sont essentiels.

1. Indice de prévisibilité

Cela mesure avec quelle précision l’équipe estime ce qu’elle peut accomplir par rapport à ce qu’elle réalise réellement.

- Calcul : Comparez les points d’histoire engagés aux points d’histoire accomplis.

- Avantage : Une haute prévisibilité renforce la confiance des parties prenantes.

- Objectif : Visez la cohérence plutôt que la production maximale.

2. Satisfaction de l’équipe

Utilisez des sondages pour mesurer le moral et l’engagement.

- Corrélation : Les équipes satisfaites ont tendance à avoir une rotation plus faible et une production de meilleure qualité.

- Fréquence : Effectuez ces sondages tous les trimestres.

- Action : Si les scores baissent, examinez la charge de travail, les blocages ou les frictions dans le processus.

3. Répartition des connaissances

Suivez combien de personnes sont capables de travailler sur des zones spécifiques du code.

- Facteur de bus : Si une seule personne connaît un module, c’est un risque.

- Indicateurs : Comptez le nombre de contributeurs uniques par module au fil du temps.

- Amélioration : Encouragez le pair programming et la formation croisée pour diffuser les connaissances.

🔄 Amélioration continue

Les indicateurs ne sont pas une destination ; ce sont une boussole. L’objectif est l’amélioration continue. Au fur et à mesure que l’équipe mûrit, les indicateurs doivent évoluer.

- Phase 1 : Transparence.Rendre les données visibles. Comprendre ce qui se passe.

- Phase 2 : Optimisation.Utiliser les données pour réduire les gaspillages et améliorer le flux.

- Phase 3 : Valeur.Déplacer l’attention vers les résultats métier et l’impact sur le client.

En diversifiant les indicateurs utilisés, les équipes peuvent éviter les pièges de l’obsession d’un seul indicateur. La vitesse et le burndown ont leur place, mais elles ne constituent qu’une partie de l’histoire. Les indicateurs de flux révèlent l’efficacité. Les indicateurs de qualité révèlent la stabilité. Les indicateurs de valeur révèlent l’impact.

Combiner ces perspectives crée une vision solide de la performance de l’équipe. Cela permet aux dirigeants de prendre des décisions éclairées sans micro-manager. Cela permet aux équipes de s’approprier leur processus sans crainte de jugement.

Commencez par choisir un nouvel indicateur à suivre. Observez-le pendant un mois. Discutez de ce qu’il révèle. Ensuite, ajoutez-en un autre. Créez une culture où les données servent l’équipe, et non l’inverse. C’est la voie vers une livraison durable et performante.